작성자: 최 득 진 박사

[전, 대학교수 |AXINOVA R&D 원장 | 챗GPT인공지능 지도사 1급 | 교육사회 전문가 | 사회분석 전문가 | 평생교육사 | AI 리서치 컨설턴트]

오픈AI(OpenAI) 최고경영자 새뮤얼 올트먼이 AGI(범용 인공지능)의 미래를 둘러싼 전망과 경고를 동시에 내놨다. 그는 AGI가 “개인별 AI 팀”을 가능케 하고 인간을 반복 업무에서 해방시킬 잠재력이 있다고 강조하는 한편, 인프라 부족과 투자 과열이 새로운 불평등을 초래할 수 있다고 지적했다.

올트먼은 최근 인터뷰에서 “AGI는 창의적 활동의 보조자로서 역할을 하며, 누구나 자신만의 맞춤형 AI 조력자를 가질 수 있는 시대가 다가오고 있다”고 설명했다. 하지만 그는 이러한 기술적 도약이 사회 전반에 균등하게 확산되기 위해서는 데이터 센터, 반도체 공급망, 전력 인프라 같은 기반 시설의 확충이 필수적이라고 강조했다. “이 자원이 특정 국가나 소수 기업에 집중된다면, AGI는 오히려 사회적 격차를 확대하는 도구가 될 수 있다”는 것이다.

또한 그는 최근의 AI 투자 흐름을 “버블”에 비유하며, GPT-5의 성과가 기대에 미치지 못한 사례를 들어 과도한 낙관론을 경계했다. “AGI의 핵심은 아직 충족되지 않았다. 자가 학습, 실시간 적응, 안전한 의사결정 등 본질적인 요소가 부족한 상황에서, 투자자들이 ‘곧 AGI가 도래한다’는 신호에 지나치게 반응하고 있다”고 분석했다.

올트먼의 메시지는 두 가지 층위에서 읽을 필요가 있다.

첫째, 그는 AGI의 기술적 가능성과 사회적 효용을 긍정하면서도, “누가 인프라를 소유하는가”라는 구조적 문제를 지적했다. 이는 단순히 기술의 발전 속도만이 아니라 자원 분배·접근성·지정학적 경쟁이 AGI 시대를 규정할 수 있음을 시사한다.

둘째, 그는 시장의 과열을 경계하며 ‘기대와 현실의 간극’을 드러냈다. GPT-5의 사례처럼, 대규모 모델이 곧바로 AGI로 이어지지 않으며, 연구자들이 해결해야 할 난제—추론의 일관성, 장기적 메모리, 안전성—은 여전히 남아있다.

앞으로의 핵심은 기술적 진보와 사회적 제도 설계의 병행이다. 올트먼이 던진 경고는 연구자·정책 결정자·투자자 모두가 “AGI 낙관론”과 “AGI 현실론” 사이에서 균형 잡힌 접근을 해야 함을 일깨운다.

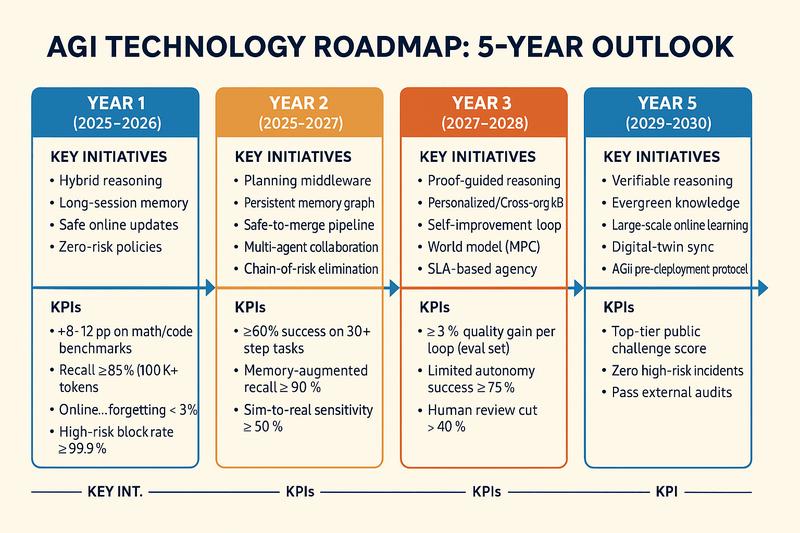

인포그래픽= 앞으로 5년은 증명가능한 추론, 장기기억, 안전한 온라인 학습, 세계모델 기반 계획을 축으로 한 모듈형 인지 아키텍처와 강력한 안전 거버넌스를 통합하는 싸움이 될 것이다.

인포그래픽= 앞으로 5년은 증명가능한 추론, 장기기억, 안전한 온라인 학습, 세계모델 기반 계획을 축으로 한 모듈형 인지 아키텍처와 강력한 안전 거버넌스를 통합하는 싸움이 될 것이다.

AGI 전환기의 과제: 올트먼 발언 속 기술적 난제들

서울국제조각페스타 2026, 코엑스서 예술과 기업의 만남 성황

서울국제조각페스타 2026, 코엑스서 예술과 기업의 만남 성황

[손현식 칼럼] 270만 외국인 시대, ‘함께 사는 법’은 배운 적이 없다

[손현식 칼럼] 270만 외국인 시대, ‘함께 사는 법’은 배운 적이 없다

AI 혁신 물결: xAI의 세계 모델, OpenAI GPT-5 업데이트, Hugging Face 오픈소스 NLP 모델 출시

AI 혁신 물결: xAI의 세계 모델, OpenAI GPT-5 업데이트, Hugging Face 오픈소스 NLP 모델 출시

할리우드 배우노조, 스튜디오 측에 새 반대 제안 테이블에 올리다

할리우드 배우노조, 스튜디오 측에 새 반대 제안 테이블에 올리다

하나님의 축복 속에서 시작된 사랑… 특별한 결혼의 여정

하나님의 축복 속에서 시작된 사랑… 특별한 결혼의 여정

목록

목록